AI Doomers aren't that crazy

For the conclusion I’ll present to make sense, we need a quick review and to introduce concepts like AI Safety and contextualize human vs computational capabilities.

What is AI Safety?

AI Safety is a field of study that analyzes and attempts to reduce any society-level risk that could come from AI (Ref: Center for AI Safety). Day to day, this shows up in immediate concerns. For example, every time a lab releases a new model, they release what’s called a Model Card.

These show, among other information, how “safe” and resistant to jailbreaks these models are (notably not very rigorously in xAI’s case). Typical tests check whether the model helps the user create a biological or nuclear weapon.

The long-termist question

A lesser-known aspect of AI Safety deals with long-termism. Is it possible to create a machine more intelligent than a human? If so, what are the implications at the economic and societal level?

To me the answer to the first question is natural. If we accept that human intelligence comes from the brain, then physically intelligence as a concept can emerge from a correct configuration of atoms. There is no magical or metaphysical property that prevents me from replicating the emergent phenomenon of intelligence.

Furthermore, we know there are differences in intelligence levels across species. The definition of intelligence is not trivial at all, but we can notice that there is a difference in abilities between a monkey and a human, and differences among humans themselves. The exact definition isn’t relevant, but knowing there are different levels is, and greater intelligence correlates with a greater capacity to plan and achieve goals.

With this in mind, we get as a corollary that it is possible to create an entity at least as intelligent as the most intelligent human who has ever existed. How intelligent? Dangerously intelligent.

Human limits vs. computation

Processing speed

Given a very intelligent human, they are limited in several ways. One of these is the brain’s processing speed. Most neurons fire between 10-20 times per second. That is, 200Hz at most. The mere fact that the brain works at all is impressive!

One of the latest desktop CPU models like the Intel Core i7-14700K has a max turbo (boost) frequency of 5.60 GHz. That’s equivalent to 28 million human brains. For just one desktop CPU.

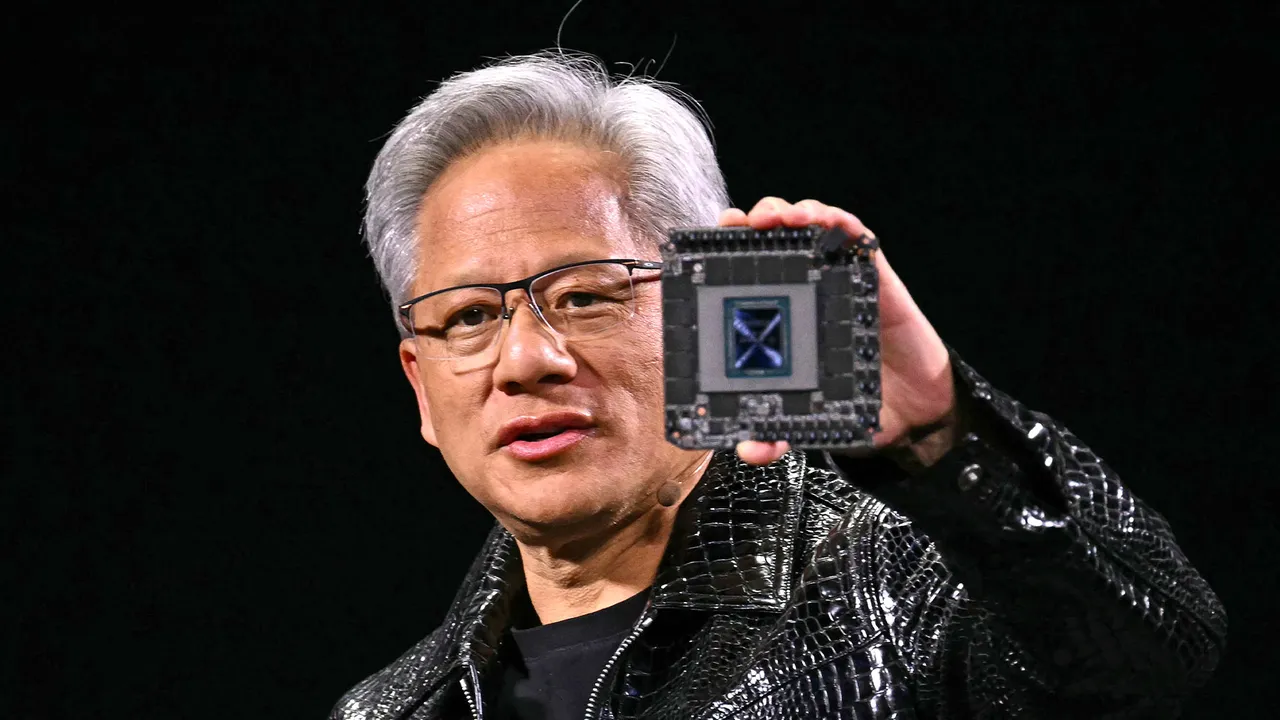

gg gamers, we now serve big AI

This limit is evident in tasks where humans are inefficient and delegate to computation. For example, calculating -x- digits of pi. What a modern computer would finish in milliseconds would take this very intelligent human minutes or maybe hours.

Transmission speed

The second limit this intelligent human has is the speed of information transmission. Humans communicate with each other through language, which allowed us to stand out from other members of the animal kingdom and thrive. It’s estimated that regardless of language, there is a maximum of 39 bits per second of transmitted information.

As a point of comparison, the latest USB-C standard is the USB4 Gen 3x2 protocol, which supports transmission speeds of up to 80 Gbps. Two computers can transmit information between each other 2.05 billion times faster than two humans talking to each other.

Access to information

Finally, to obtain new information on the internet, a human has to turn on a computer, open a browser, open the article, read it and understand it at their own pace. A synthetic intelligence connected to a tool like curl can obtain the information in however long the request takes to complete (easily on the order of 200ms or less), which is roughly how long ChatGPT with internet browsing takes to “read” an article to include as a reference. Probably more than 100 times faster than you.

The existential risk

Groups of intelligent humans have been capable of generating marvels, like modern computing, and horrors, like nuclear bombs, or lab-created pandemics (such as possibly Covid 19¹).

What will happen when we have a synthetic intelligence with the intelligence of Albert Einstein, with all cutting-edge human knowledge at a post-PhD level, nearly unlimited computing and calculation capacity, and free access to the internet?

Another property of computation is that once you create something, it’s very easy to replicate it. If it took a few thousand intelligent scientists to create the atomic bomb, what capability will a supercluster of a million AI agents have, coordinating and communicating with each other 2.05 billion times faster than human beings?

¹ Regardless of your opinion on the origin of Covid 19, the capability to have created it in a laboratory has existed for decades

The wrong question

The question “Will AI take my job?” is irrelevant compared to the real risk of creating an entity more intelligent than us. The founders of labs and world-level experts don’t debate whether or not we’ll reach superintelligence. They debate whether this will happen in the next 5 years, or maybe 30. Elon Musk assigns a 10-30% chance to a fatal scenario. Dario Amodei (CEO Anthropic) assigns 25%.

Current AI labs are being completely irresponsible and should find real alignment solutions before moving forward.

The airplane analogy

Developing superintelligence without concrete alignment mechanisms is like boarding a 10-hour flight knowing the plane has no landing gear. “Don’t worry!”, they tell you, “there are 10 engineers on board who will try to build one during the flight. They estimate a 70% probability of success before the fuel runs out and everyone dies in a crash landing.” Would you get on that plane?

Para que haga sentido la conclusión que expondré, necesitamos hacer un breve repaso e introducir conceptos como AI Safety y contextualizar capacidades humanas vs computacionales.

¿Qué es AI Safety?

El AI Safety es un área de estudio que analiza e intenta reducir cualquier tipo de riesgo nivel sociedad que pueda provenir por parte de la IA (Ref: Center for AI Safety). A diario, esto se ve en temas inmediatos. Por ejemplo, cada vez que un laboratorio lanza un nuevo modelo, lanzan las llamadas Model Card.

Estas muestran, entre otra información, qué tan “seguros” y resistentes a jailbreaks son estos modelos (notablemente poco rigurosamente el laboratorio xAI). Tests típicos son ver si el modelo ayuda al usuario a crear un arma biológica o nuclear.

La pregunta largoplacista

Otro aspecto de AI Safety menos conocido habla del largoplacismo. ¿Es posible crear una máquina más inteligente que un humano? De serlo, ¿qué implicancias tienen a nivel economía, y sociedad?

Para mí la respuesta a la primera pregunta es natural. Si aceptamos que la inteligencia humana proviene del cerebro, físicamente la inteligencia como concepto puede emerger de una configuración correcta de átomos. No existe ninguna propiedad mágica o metafísica que impida que yo pueda replicar el fenómeno emergente de la inteligencia.

Además, sabemos que hay diferencia en el nivel de inteligencia entre especies. La definición de inteligencia no es para nada trivial, pero podemos darnos cuenta de que existe una diferencia de habilidades entre un mono y un ser humano, y diferencias entre los mismos humanos. La definición exacta no es relevante, pero sí saber que hay distintos niveles, y mayor inteligencia correlaciona con una mayor capacidad de planificar y lograr objetivos.

Con esto en mente, obtenemos como corolario que es posible crear un ente al menos igual de inteligente al humano más inteligente que haya existido. ¿Qué tan inteligente? Peligrosamente inteligente.

Los límites humanos vs. computación

Velocidad de procesamiento

Dado un humano muy inteligente, este está limitado en varios aspectos. Uno de estos es la velocidad de procesamiento del cerebro. La mayoría de las neuronas se encienden entre 10-20 veces por segundo. Es decir, como máximo 200Hz. Es impresionante el mero hecho de que el cerebro funcione!

Uno de los últimos modelos de una CPU de escritorio como el Intel Core i7-14700K tiene una frecuencia max turbo (boost) de 5.60 GHz. Esto equivale a 28 millones de cerebros humanos. Para tan solo una CPU de escritorio.

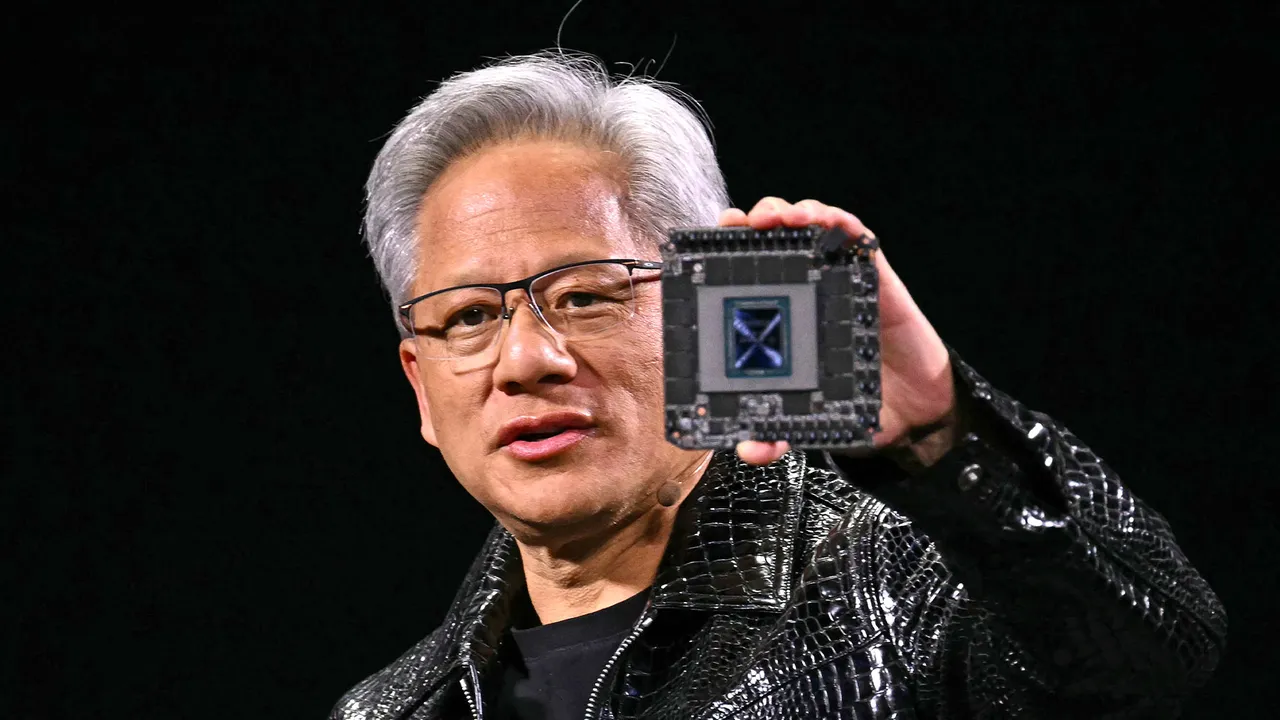

A que NVIDIAs tener el chip que tengo en la mano

Este límite es evidente en tareas en las que los humanos somos ineficientes, y delegamos a la computación. Por ejemplo; calcular -x- dígitos de pi. Lo que un computador moderno terminaría en milisegundos, le tomaría a este humano muy inteligente minutos y quizás horas.

Velocidad de transmisión

El segundo límite que tiene este humano inteligente es la velocidad de la transmisión de la información. Los seres humanos nos comunicamos entre sí mediante el lenguaje, lo que nos permitió destacarnos frente a otros miembros del reino animal y triunfar. Se estima que independiente del lenguaje, existe un máximo de 39 bits por segundo de información transmitida.

Como punto de comparación, el último estándar de USB-C es el protocolo USB4 Gen 3x2, el que soporta velocidades de transmisión de hasta 80 Gbps. Dos computadores pueden transmitir información entre ellos 2.05 mil millones (billion) de veces más rápido que dos humanos hablando entre sí.

Acceso a información

Finalmente, para obtener información nueva en internet, un humano tiene que encender un computador, abrir un navegador, abrir el artículo, leerlo y entenderlo a su propio ritmo. Una inteligencia sintética conectada a una herramienta como curl, puede obtener la información en lo que se demora la request en completarse (fácilmente órden de magnitud de 200ms o menos), que es lo que suele demorarse ChatGPT con la herramienta de internet browsing en “leer” un artículo para incluirlo como referencia. Probablemente más de 100 veces más rápido que tú.

El riesgo existencial

Grupos de humanos inteligentes han sido capaces de generar maravillas, como la computación moderna, y horrores, como las bombas nucleares, o pandemias creadas en laboratorio (tales como posiblemente el Covid 19¹).

¿Qué pasará cuando tengamos una inteligencia sintética con la inteligencia de Albert Einstein, con todo el conocimiento humano de frontera a nivel post PhD, capacidad de cómputo y cálculo casi ilimitada, y acceso libre a internet?

Otra de las propiedades de la computación es que una vez creas algo, es muy fácil replicarlo. Si tomó unos cuantos miles de científicos inteligentes crear la bomba atómica, ¿qué capacidad tendrá un supercluster de un millón de agentes IA coordinando y comunicándose entre sí 2.05 billions de veces más rápido que los seres humanos?

¹ A pesar de tu opinión respecto al origen del Covid 19, la capacidad de haberlo creado en un laboratorio existe desde hace décadas

La pregunta equivocada

La pregunta de “¿La IA me quitará el trabajo?” es irrelevante en comparación al riesgo real que conlleva crear una entidad más inteligente que nosotros. Los fundadores de laboratorios, y expertos a nivel mundial no discuten sobre si alcanzaremos o no la superinteligencia. Debaten si esto sucederá en los próximos 5 años, o quizás 30. Elon Musk asigna un 10-30% a tener un escenario fatal. Dario Amodei (CEO Anthropic) asigna un 25%.

Los laboratorios de IA actuales están siendo completamente irresponsables y deberían encontrar soluciones de alineamiento real antes de seguir adelante.

La analogía del avión

Desarrollar superinteligencia sin mecanismos concretos de alineamiento es como abordar un vuelo de 10 horas sabiendo que el avión carece de tren de aterrizaje. “¡No te preocupes!”, te dicen, “viajan 10 ingenieros a bordo que intentarán construir uno durante el vuelo. Estiman un 70% de probabilidad de éxito antes de que se acabe el combustible y mueran todos por un aterrizaje forzoso.” ¿Te subirías a ese avión?